AI는 책임을 지지 않는다. 책임을 지는 것은 인간이다.

에보 키친에 그 선반 설치하러.

손님이 사 온 고리키 아일랜드 선반 받침은 한 세트에 15,000엔 정도 한다.

그래서 그거에 안 밀리게 타모(물푸레나무) 한 장 통판으로 선반을 만들어 왔다.

어라.. 집 지었을 당시, 스위치 플레이트도 고리키였네.

그건 맞춰야지,,, 미안(ㅋㅋ)

멋지게 달았습니다ーー.

선반 재료비랑 손품값 해서 10,000엔 청구하려고 한다(초특가)

근데, 고작 이런 선반에 합계 25,000엔이라니,,,,

키친을 예쁘게 해버리면, 홈센터에서 파는 싼 선반으로는 못 가겠지..

힘들다(ㅋㅋ)

키친 상판이랑 타일 사이 코킹이 끊어져 있길래 하청에 연락해뒀다.

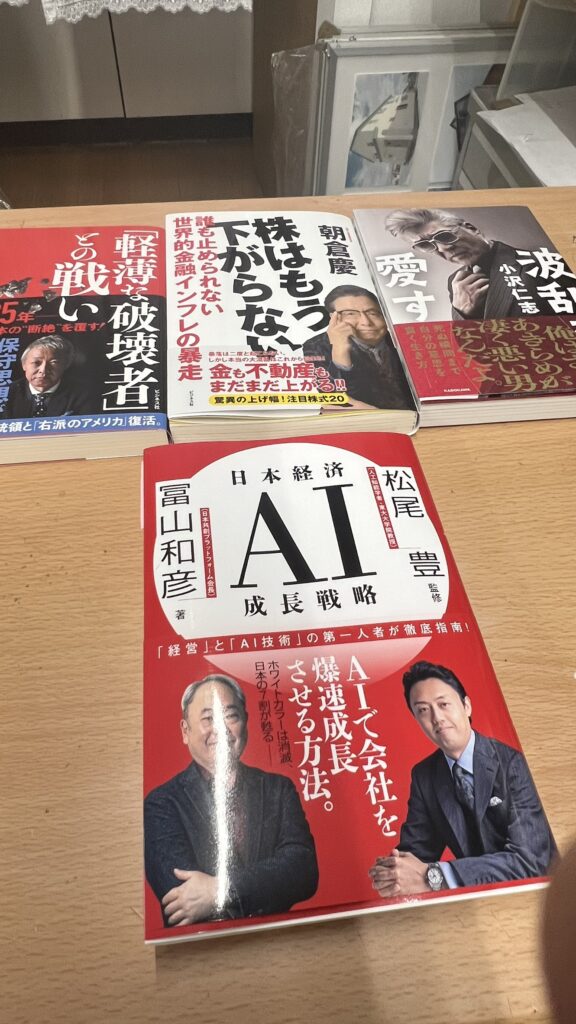

AI 책, 어렵긴 했지만 열심히 읽었다.

AI는 책임을 지지 않는다. 책임을 지는 건 인간이다.

서빙 로봇이 뜨거운 라멘을 확 끼얹어도 로봇은 모른 척. AI 건축으로 집이 휘어도, AI 운전으로 사람을 치어도 똑같다. 마지막에 OK 사인한 사람이 뒷수습한다.

그래서 이 책은 “화이트칼라 전멸”이 아니라, 보스력(=책임을 짊어질 수 있는 놈)이 살아남는다고 써 있었다.

실패했던 DX 시대는 AX(AI 트랜스포메이션) 시대로 진화한다는 거다.

확실히 DX는 쓰는 쪽에서 중간관리자보다 위가 팩스·가라케이 세대라 무리가 있었는데,

AI가 되면 “전 국민 1억 도쿄대 졸업” 같은 착각을 할 테니 그런 시대가 올지도 모르지.

지금까지 “부하가 나빠”로 도망치던 상사도, “AI가 나빠”는 안 통한다. 확인 안 한 네가 잘못이 된다.

특히 책임감 있는 자격자는 결국 다 검토하니까, 애초에 자기가 하는 게 더 빠르다… AI 방해된다, 라고 할지도.

요즘은 AI 상재(商材) 팔이가 우르르 몰려오는데, 책임이 사용자(설계·운용) 쪽에 있는 건 당연하고, 상재 팔이는 책임 안 진다.

아는 척하며 돈만 빨아먹고 회사가 망해도 책임 안 지는 ‘경영 컨설턴트’ 같은 거다.

그런데 가라케이(모양은 스마트폰인데 전화 기능이랑 가슴 사진 보는 것밖에 못 함) 네이티브 상사들은 “이거 편하네” 하고 착각해서 쉽게 써 먹다가 대형사고 낼 거다.

“아 그거? 당연히 알지” 하고 등 돌려 AI에 물어본다. 가라케이 네이티브인 그들은 아는 척이 무기니까.

AI를 도구로 쓸 건지, 의존해서 AI에 보고서나 업무 보고까지 통째로 떠넘기고 더 멍청해질 건지.

AI는 못 박는 네일건 같은 거라 손으로 치는 것보다 빠르지만, 빗나가면 옆집 창문을 뚫어버린다.

결국 가성비·타임파와 리스크의 줄다리기. 편해지려 할수록 리스크는 커진다.

AI는 추론 모델이다. 정답을 “추측”하는 데 능할 뿐. 세상 인터넷 정보를 미친 듯이 뒤져서 “2차 정보”를 그럴듯하게 말하는 도구.

그 2차 정보를 AI가 또 비비고 비벼 3차 4차로 현실에서 멀어진다. AI 업계에서 요즘 자주 나오는 “모델 붕괴(Model Collapse)”다.

AI란 “못을 박아본 적은 없지만, 박는 법은 아는 놈”

이거 100% 손가락 찍는 패턴(ㅋㅋ)

니트의 독서감상문이었습니다♪